Jahresbericht 2024

Die Berliner Beauftragte für Datenschutz und Informationsfreiheit hat nach § 12 Berliner Datenschutzgesetz und § 18 Abs. 4 Berliner Informationsfreiheitsgesetz dem Abgeordnetenhaus und dem Senat von Berlin jährlich einen Bericht über das Ergebnis ihrer Tätigkeit vorzulegen. Der vorliegende Bericht schließt an den Jahresbericht 2023 an und deckt den Zeitraum zwischen 1. Januar und 31. Dezember 2024 ab.

Diese Publikation ist unter der Creative Commons Namensnennung 4.0 International Lizenz (CC BY 4.0) lizenziert und darf unter Angabe der Urheberin, der vorgenommenen Änderungen und des Links zur Lizenz frei vervielfältigt, verändert und verbreitet werden. Bei einer kommerziellen Nutzung bittet die Urheberin um Mitteilung. Den vollständigen Lizenztext finden Sie unter https://creativecommons.org/licenses/by/4.0/deed.de.

Inhalt

2. Die DSGVO in Abgrenzung zur ePrivacy-Richtlinie

1. Bußgeld wegen Sicherheitslücken in einer Praxismanagementsoftware

2. Missbräuchliche POLIKS-Abrufe

1. Anträge nach dem Informationsfreiheitsgesetz – Erhebung einer Postadresse

2. Gemeinsam die Informationsfreiheit und das Transparenzrecht stärken

3. Schnelle Bearbeitung von IFG-Anträgen

4. Akteneinsicht in bezirkliche Bauakten

5. Informationsfreiheit und Datenschutz

1. Künstliche Intelligenz in der Berliner Verwaltung

2. Erste Erkenntnisse aus großen Prüfverfahren zu Künstlicher Intelligenz

1. Einsatz von Gesichtserkennungssystemen ohne Rechtsgrundlage

2. Zu weitreichende Videoüberwachung der Polizeiwache am Kottbusser Tor

3. Zuverlässigkeitsüberprüfungen bei Großveranstaltungen: Grenzen der polizeilichen Befugnisse

4. Automatisierte Datenabrufe einzelner Personen aus dem Melderegister durch Behörden

VI. Digitalisierung in der Verwaltung

1. Quo vadis? Wie ist Berlins Digitalstrategie für die Zukunft?

2. Standardprozess Datenschutz bei öffentlichen Digitalisierungsvorhaben

3. Digitale Akte als Testlauf für den Standardprozess Datenschutz

1. Fortschritte bei der Schuldigitalisierung

2. Novellierung schulgesetzlicher Normen

1. Berliner Datenschutzwegweiser für Kitas

2. Kinder- und Jugendschutz als zentrales Anliegen

3. Multiinstitutionelle Fallkonferenzen in Hochrisikofällen

1. Hilfestellung bei der KIS-Beschaffung

2. Aufsichtszuständigkeit für Unternehmen zur Onlinebuchung von Arztterminen (Fortsetzung)

3. Prüfung einer Website zur Bestellung ärztlicher Verordnungen

X. Mobilität und Daseinsvorsorge

1. Einsatz von Bodycams durch die Berliner Verkehrsbetriebe

2. Einführung des Deutschlandsemestertickets

3. Verlängerung der Speicherdauer von Videoaufnahmen der Berliner Verkehrsbetriebe

4. Fortführung der Sicherheitsmaßnahmen der Berliner Bäder-Betriebe

5. Es läuft: Funkwasserzähler datenschutzkonform einsetzen

XI. Arbeit und Beschäftigtendatenschutz

1. Personalakten sind nicht Teil des Bewerbungsverfahrens

2. Keine Videoaufzeichnungen von Befragungen durch Arbeitgeber:innen

XII. Wirtschaft und Digitalwirtschaft

1. Onlinewerbung und Trackingrisiken

2. Prüfung eines Onlinewerbeunternehmen

3. Vor-Ort-Prüfung zur Übernahme eines Wohnungsbestands

4. Code-Ident-Verfahren zum Nachweis von Einwilligungen in Werbeanrufe

XIII. Parteien und Gesellschaft

1. Datenschutz im Abgeordnetenhaus

2. Offener Brief an die im Bundestag vertretenen Parteien zum Political Targeting

3. Datenschutzverstöße bei politischer Werbung in sozialen Medien

1. Unzulässiges Erschweren der Geltendmachung von Löschungsansprüchen

2. Datenminimierender Nachweis der Auskunftserteilung

3. Wann sind Anträge von Betroffenen „exzessiv“?

4. Auskunftspflicht für Logdateien

XV. Datenpannen und technischer Datenschutz

1. Vereinheitlichung der Meldung von Datenpannen

2. Nicht gelöschte Daten als Datenpannenrisiko

3. Häufige Ursachen für Datenpannen

I. Gesetzesvorhaben des Bundes

1. Wir setzen uns für eine einheitliche Auslegung des Datenschutzrechts ein – auch ohne BDSG-Reform

2. Umsetzung der KI-Verordnung in nationales Recht: Wer ist für die KI-Aufsicht zuständig?

3. Entwurf eines Gesetzes zur Einführung eines Registerzensus

4. Digitaler Check-in und gesetzliche Neuerungen bei Beherbergungsbetrieben

II. Zusammenarbeit mit deutschen Datenschutzaufsichtsbehörden

1. Kostenfreie Auskunftsersuchen bei Ärzt:innen

2. Einsatz von Gesichtserkennung durch Sicherheitsbehörden

3. Ein „Einer für alle“-Modell beim Datenschutz?

4. Neue Entwicklungen im Forschungsbereich

5. Eine neue Form der Datenverarbeitung durch die Bezahlkarte

6. Modelle und Systeme Künstlicher Intelligenz: Hinweise für Hersteller:innen

7. Die neue Orientierungshilfe Digitale Dienste

I. Mitarbeit im Europäischen Datenschutzausschuss

1. Pseudonymisierung und Anonymisierung

2. Klares Signal zu Consent-or-Pay-Modellen – Datenschutz nicht nur gegen Entgelt

3. EDSA-Leitlinien und EuGH-Rechtsprechung zum berechtigten Interesse

4. Stellungnahme des EDSA zu Künstlicher Intelligenz

5. Erstes deutsches Zertifizierungsprogramm für Verantwortliche

6. Entscheidung des EDSA zu Zugriffen auf Smartphones

II. Internationale Zusammenarbeit

1. Bericht von der Internationalen Konferenz der Informationsfreiheitsbeauftragten

2. Internationale Arbeitsgruppe für Datenschutz in der Technologie

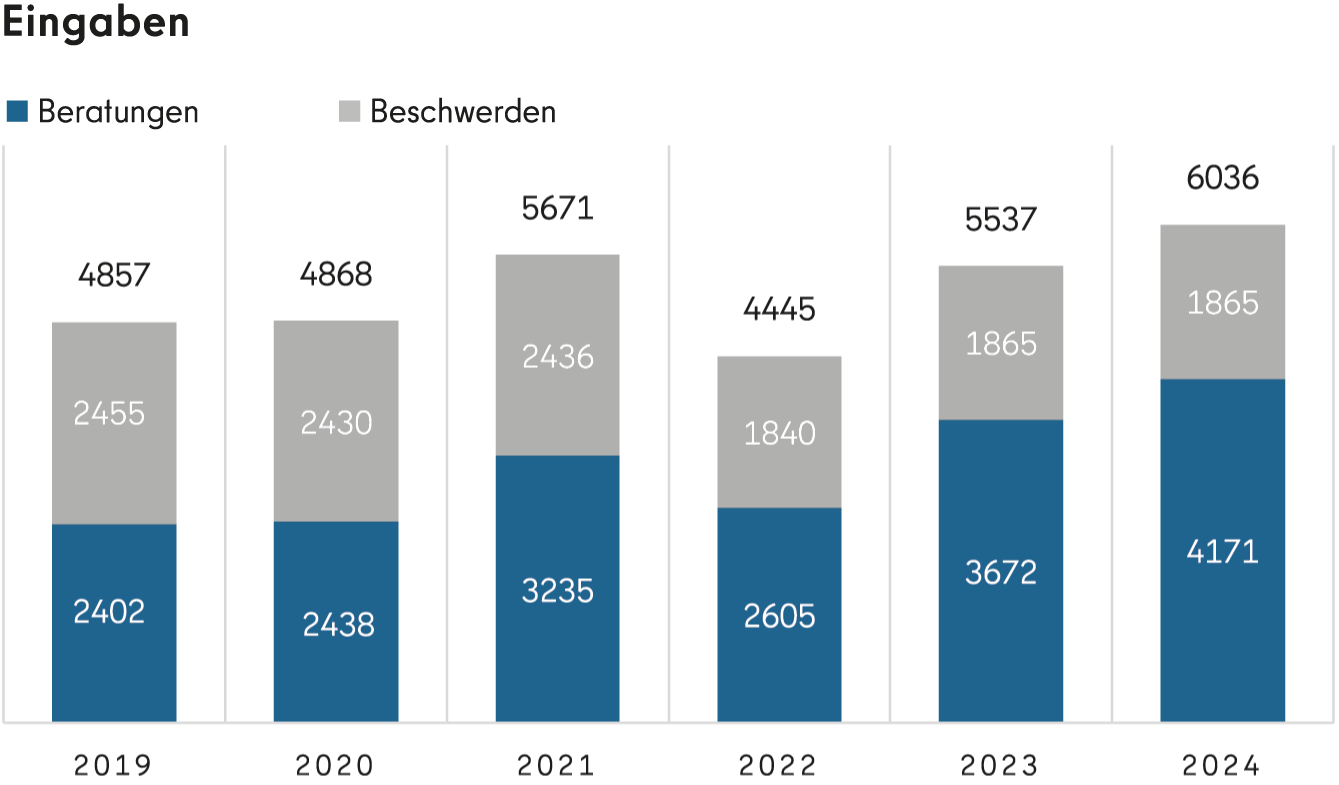

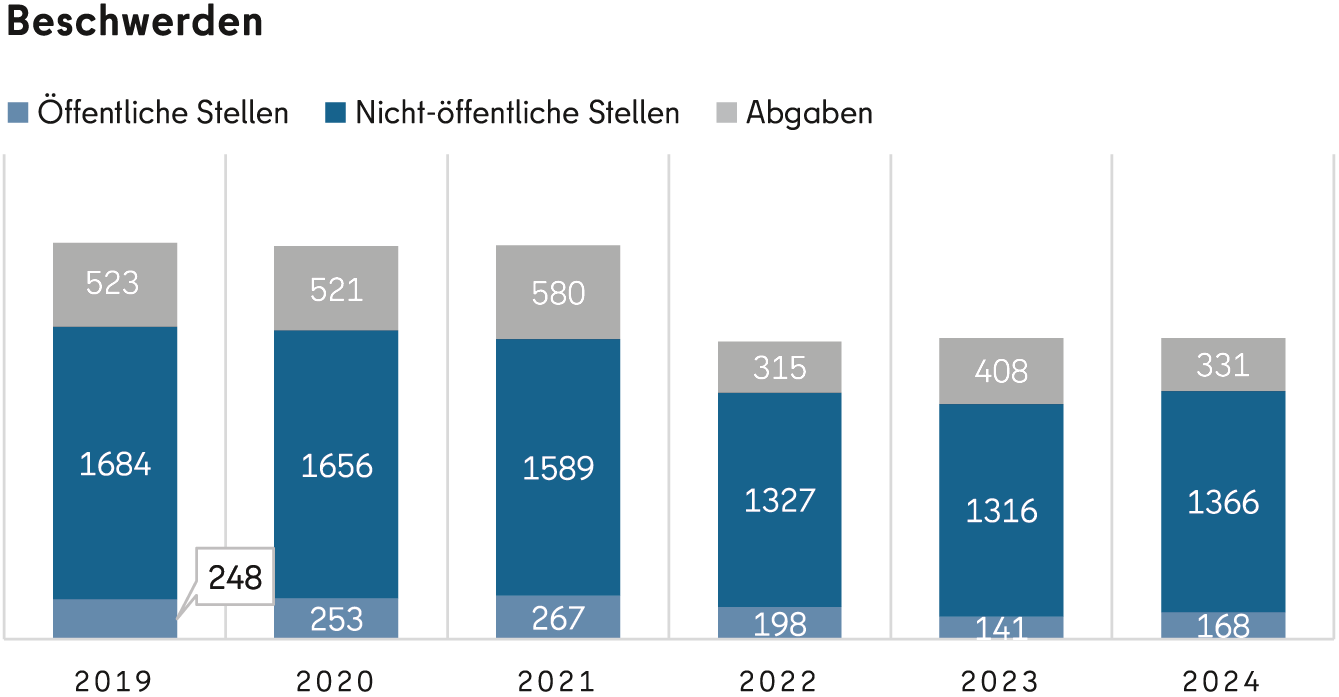

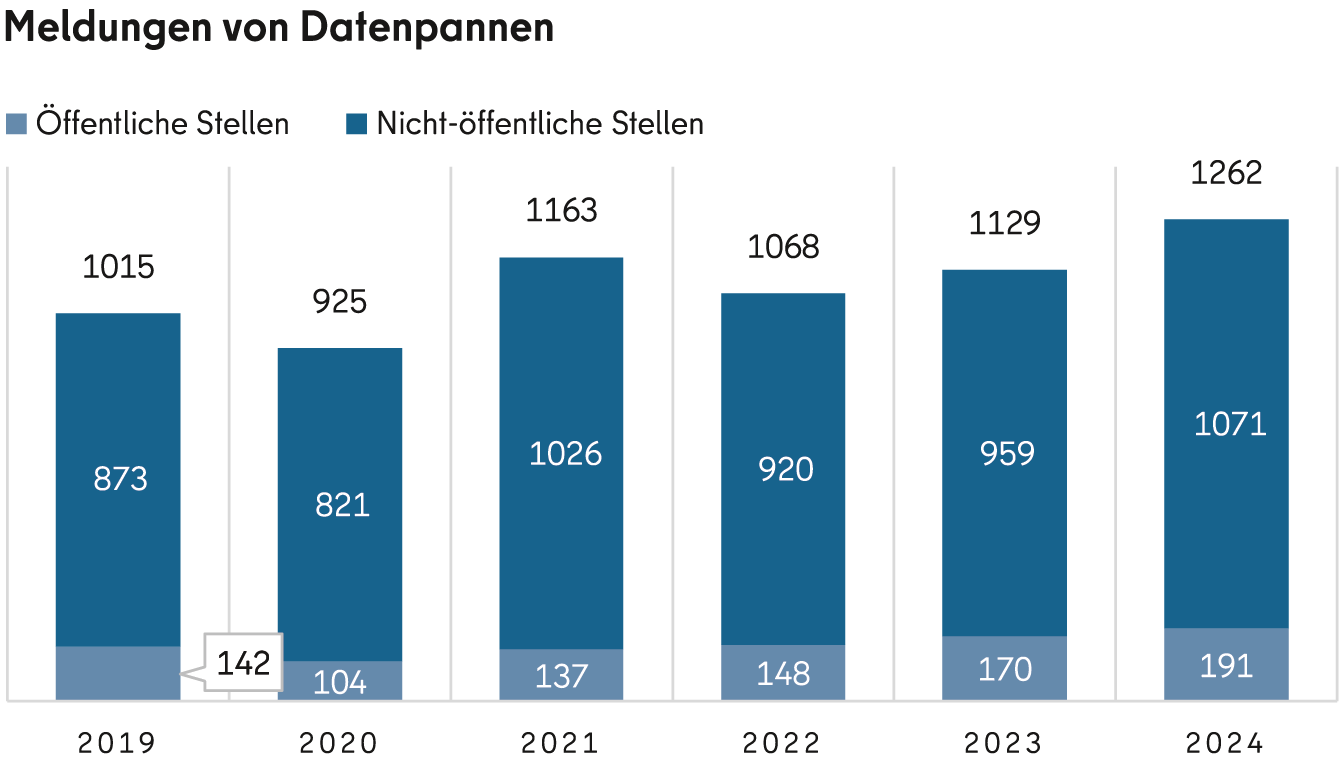

1. Beratungsanfragen und Beschwerden

3. Anträge und Beschwerden nach dem Informationsfreiheitsgesetz

II. Abkürzungen

Vorwort

Die Europäische Union hat in den letzten Jahren im Rahmen ihrer Daten- und Digitalstrategie eine Reihe von Rechtsakten erlassen, um im Rahmen der europäischen Werte Potenziale der Datennutzung besser auszuschöpfen. Dabei spielen etwa der Digital Services Act, der Data Act, die KI-Verordnung und der Data Governance Act eine Rolle, die viele Schnittstellen zur Datenschutz-Grundverordnung aufweisen, diese aber im Wesentlichen unberührt lassen sollen. Diese Schnittstellen werden in der Datenschutzaufsicht der kommenden Jahre eine besondere Rolle spielen.

Zur nationalen Durchführung der Europäischen Datenstrategie und ihrer Rechtsakte sollte daher ein national stringentes Gesamtkonzept der Aufsicht überlegt werden, das auch die vorhandenen föderalen Aufsichtsstrukturen im Datenschutz in den Blick nimmt. Rechtspolitische Äußerungen und erste Gesetzesentwürfe zu den verschiedenen Digitalrechtsakten weisen jedoch darauf hin, dass der Bund die Richtung einer zentralistischen Aufsicht eingeschlagen hat. Mit Sorge beobachte ich diese Bestrebungen einer Kompetenzverlagerung zum Bund, die auch die Datenschutzaufsicht betrifft und die Mitgestaltungs- und Einflussmöglichkeiten der Länder im Hinblick auf die digitalen Zukunftsthemen vermindern würde. Dies wäre auch zum Nachteil der Berliner:innen sowie der regionalen Unternehmen und Vereine, die von unseren individuellen Beratungen, spezifischen Veranstaltungsformaten und unserer lokalen Ansprechbarkeit profitieren. Letztlich könnte verloren gehen, was dezentrale, föderale Strukturen ausmacht: Partizipation, Bürger:innennähe, Nachvollziehbarkeit, Machtausgleich und vor allen Dingen Qualitätssicherung und Best Practice in der gemeinsamen Abstimmung unter den Ländern. Es sollte daher genau geschaut werden, wie eine funktionale, effektive Aufsicht beibehalten und für die neuen Rechtsakte etabliert werden kann, ohne dass auf die Vorteile einer lokalen Aufsichtsstruktur verzichtet werden muss.

Die Überwachung und die Durchsetzung der Datenschutz-Grundverordnung bei der Anwendung von KI findet mehr und mehr Eingang in unsere Aufsichtspraxis. In ersten Prüfverfahren der KI-Nutzung von Unternehmen haben wir bereits Datenschutzverstöße ausmachen können, die es in der Zukunft zu vermeiden bzw. abzustellen gilt. Bedeutsam ist dabei insbesondere die Frage, auf welcher Rechtsgrundlage die Verarbeitung von personenbezogenen Daten bei der Entwicklung und dem Einsatz von KI erfolgt und wie die erforderliche Transparenz für die betroffenen Personen hergestellt werden kann. Von Relevanz ist zudem, dass beim Einsatz von generativer KI bzw. großen Sprachmodellen häufig zweifelhaft ist, ob die Verarbeitung personenbezogener Daten beim Training der KI-Modelle rechtmäßig war. Wie wirkt sich etwa ein rechtswidriges Training von KI auf den späteren Einsatz des Modells in einem KI-System aus? Erste Antworten auf diese sehr wesentlichen Fragen gibt die Stellungnahme des Europäischen Datenschutzausschusses, die Ende des Jahres veröffentlicht wurde und an der auch wir intensiv mitgewirkt haben.

Die Medienkompetenz von Kindern und Jugendlichen sowie pädagogischen Fachkräften zu fördern, bleibt eine wichtige Aufgabe für uns. Im Mittelpunkt steht die informationelle Selbstbestimmung junger Menschen. In diesem Jahr nahmen wir dazu an wichtigen Bildungs- und Digitalveranstaltungen teil, gaben Workshops an Schulen und begleiteten den neuen multimedialen Datenschutzwegweiser für Kitas der Senatsverwaltung für Bildung, Jugend und Familie. Damit bieten wir praxisnahe Unterstützung und schaffen mehr Transparenz bei Datenschutzfragen im Kitaalltag.

Eine aufschlussreiche Lektüre wünscht

Meike Kamp

Berliner Beauftragte für Datenschutz und Informationsfreiheit

A.

Wir in Berlin

I. Gerichtsverfahren

1. Adresshandel vor Gericht

In zwei Fällen sind wir wegen der Überprüfung der Zulässigkeit des gewerblichen Handels mit Adressdaten in Verfahren vor dem Berliner Verwaltungsgericht (VG Berlin). In beiden Fällen beauftragten die werbenden Stellen jeweils Adresshändler:innen, postalische Werbung an potenzielle Kund:innen bzw. Wähler:innen zu versenden. Die Werbenden und die Adresshändler:innen handelten dabei nach unserer Auffassung als gemeinsame Verantwortliche. Die Verarbeitung personenbezogener Daten zum Zwecke der Versendung von Werbung hielten wir vorliegend für rechtswidrig. Wir verwarnten daher jeweils die werbenden Stellen mit Sitz in Berlin, die hiergegen Rechtsschutz vor dem VG Berlin ersuchten.

In einem Fall verwarnten wir den Landesverband einer Partei, weil dieser einem Beschwerdeführer ein Wahlwerbeheft zugeschickt hatte. Der Beschwerdeführer hatte der Partei seine Daten hierfür nicht zur Verfügung gestellt. Vielmehr „mietete“ der Landesverband zur einmaligen Nutzung zu Werbezwecken von einem Adresshändler Adressdaten, denen u. a. die Merkmale „Performer“, „konservativ-etabliert“ oder „liberal-intellektuell“ zugeschrieben wurden. Daraufhin übermittelte der Adresshändler mehr als 130.000 Datensätze im Auftrag der Partei an einen sog. Lettershop, der dann im Rahmen einer Auftragsverarbeitung das vom werbenden Unternehmen zur Verfügung gestellte Werbematerial an die vom Adresshändler übergebenen Adressen versendete.

Im anderen Fall erhielt eine Beschwerdeführerin ein Werbeschreiben eines Unternehmens für eine Kulturveranstaltung. Auch hier hatte die Beschwerdeführerin ihre Daten nicht mitgeteilt, sondern das Unternehmen einen Adresshändler eingeschaltet. Dieser selektierte aus seinem Datenbestand nach den Vorgaben des Unternehmens Personen, denen die Merkmale „wohnhaft in Berlin“ oder „wohnhaft in Brandenburg“ und „Kaufkraft stark überdurchschnittlich“ oder „Kaufkraft überdurchschnittlich“ zugeordnet waren. Die Datenübermittlung erfolgte ebenfalls im oben beschrieben Lettershop-Verfahren.

Die Adresshändler:innen und die Werbenden sind nach unserer Bewertung vorliegend jeweils gemeinsam Verantwortliche. Die Datenschutz-Grundverordnung (DSGVO) geht nach Art. 26 von gemeinsam Verantwortlichen aus, wenn zwei oder mehr Verantwortliche gemeinsam die Zwecke der und die Mittel zur Verarbeitung festlegen.1 Gemeinsamer Zweck der Verarbeitung ist hier die Direktwerbung an die von den Adresshändler:innen anhand der Kriterien der Werbenden ausgewählten Adressat:innen.

Gleiches gilt auch für die wesentlichen Mittel des Versands der Direktwerbung, bei dem das Verfahren durch die Adresshändler:innen und den konkreten Inhalt des Werbeschreibens sowie die Auswahl der Adressat:innen durch die Werbenden (mit)festgelegt wurde. Der Annahme einer gemeinsamen Verantwortlichkeit steht auch nicht entgegen, dass ein Lettershop eingesetzt wurde und die Werbenden in bestimmten Konstellationen keinen Zugang zu den personenbezogenen Daten hatten. Nach der Rechtsprechung des Europäischen Gerichtshofs (EuGH)2 kann über die Zwecke und Mittel der Datenverarbeitung auch entscheiden, wer die Daten nicht selbst verarbeitet, also selbst keinen Zugriff auf sie hat. Im Rahmen unserer Verfahren haben die Werbenden bestritten, gemeinsam mit den jeweiligen Adresshändler:innen verantwortlich zu sein. Die nach Art. 26 DSGVO notwendige Vereinbarung zwischen gemeinsam Verantwortlichen wurde dementsprechend nicht abgeschlossen.

Die Verarbeitung der personenbezogenen Daten zum Zwecke der Bewerbung erfolgte in unseren Beschwerdefällen auch ohne Rechtsgrundlage. Die Werbenden konnten sich nicht auf ein berechtigtes Interesse3 stützen. Dem berechtigen Interesse steht hier die vernünftige Erwartung der betroffenen Personen entgegen,4 dass ihre personenbezogenen Daten weder zu Zwecken des Adresshandels monetarisiert werden, noch dass sie ohne vorherigen Kontakt zu dem Werbenden bzw. ohne Freigabe gezielte Werbung erhalten. Im Falle des Landesverbands der Partei ist zusätzlich zu beachten, dass Parteien bei den Meldebehörden eine Wählerauskunft haben, um an Adressdaten von Personen zu gelangen, die überhaupt wahlberechtigt sind,5 sodass auch in diesem Punkt die Erforderlichkeit des Adresshandels in Frage steht.

Die Partei hat ihr Verfahren nicht weiter betrieben, sodass die Klage als zurückgenommen fingiert wurde. Die Verwarnung ist damit bestandskräftig und bindet die Partei zukünftig. In dem Verfahren des Kulturunternehmens wird eine gerichtliche Entscheidung für das kommende Jahr erwartet. Zwischenzeitlich hat sich auch der EuGH mit den Anforderungen der entgeltlichen Weitergabe von personenbezogenen Daten zu Werbezwecken nach Art. 6 Abs. 1 Satz 1 lit. f DSGVO befasst. Der EuGH hat u. a. festgestellt, dass neben der Ermöglichung der Kontrolle der betroffenen Personen über die Offenlegung ihrer Daten auch die „maßgebliche und angemessene Beziehung“6 dieser zum werbenden Unternehmen eine wichtige Rolle spielt.7

In den Klageverfahren vor dem VG Berlin geht es um die gemeinsame Verantwortlichkeit von Werbenden und Adresshändler:innen sowie um die Grenzen des Art. 6 Abs. 1 Satz 1 lit. f DSGVO im Adresshandel und damit um wesentliche datenschutzrechtliche Fragestellungen in diesem Bereich, zu denen wir uns eine Klärung erhoffen. Das Thema Adresshandel begegnet uns als Aufsichtsbehörde aber nicht nur im Bereich der postalischen Werbung. Wir erhalten auch vermehrt Beschwerden, bei denen werbende Unternehmen die E-Mail-Adressdatensätze dritter Unternehmen zur Versendung von Werbe-E-Mails an Verbraucher:innen nutzen. Neben der gemeinsamen Verantwortlichkeit nach Art. 26 DSGVO spielt in diesen Fällen auch eine Rolle, dass E-Mail-Werbung nach § 7 Abs. 2 Nr. 2 Gesetz gegen den unlauteren Wettbewerb (UWG) grundsätzlich einwilligungsbedürftig ist.

2. Die DSGVO in Abgrenzung zur ePrivacy-Richtlinie

Das VG Berlin hat sich mit dem Verhältnis der sog. ePrivacy-Richtlinie8 zur DSGVO auseinandergesetzt und klargestellt, dass die Zielrichtung des auf der ePrivacy-Richtlinie beruhenden § 7 UWG zwar die Zulässigkeit von Direktwerbung betrifft, die Norm jedoch gerade nicht die Rechtmäßigkeit der Datenverarbeitung regelt.9 In dem Verfahren hatte eine Verantwortliche gegen eine Verwarnung geklagt, mit der wir die Verwendung von E-Mail-Adressen zu Werbezwecken beanstandet hatten. Die Klägerin hat gegen das Urteil des VG Berlin einen Antrag auf Zulassung zur Berufung gestellt.

Die Klägerin betreibt ein Internetportal zur Anmietung von Ferienunterkünften. Fragten Kund:innen über dieses Portal eine Ferienwohnung bei Vermieter:innen an, speicherte die Betreiberin des Portals die angegebene E-Mail-Adresse und nutzte diese, um Werbung zu verschicken.

Wir verwarnten die Klägerin, weil es an einer Rechtsgrundlage zu dieser Verarbeitung der E-Mail-Adressen fehlte. Die Klägerin reichte vor dem VG Berlin Klage ein und trug vor, dass wir im konkreten Fall gar nicht als Aufsichtsbehörde hätten handeln dürfen, da sich die Frage nach der Zulässigkeit des Versands der Werbe-E-Mails ausschließlich nach den Regelungen der ePrivacy-Richtlinie, also den Regelungen des UWG, richte und nicht nach der DSGVO. Im Übrigen bestünde für eine Direktwerbung an Bestandskund:innen auch ein berechtigtes Interesse S. d. Art. 6 Abs. 1 Satz 1 lit. f DSGVO.

Das VG Berlin sah keinen Anwendungsvorrang der ePrivacy-Richtlinie gegenüber der DSGVO,10 sondern vertrat die Ansicht, dass vorliegend unterschiedliche Zielrichtungen verfolgt werden: Während Art. 13 ePrivacy-Richtlinie, der in § 7 UWG umgesetzt wurde, den Schutz vor unzumutbarer Belästigung bezweckt, verfolgt Art. 6 DSGVO das Ziel, die Betroffenen vor der unrechtmäßigen Verwendung ihrer personenbezogenen Daten zu schützen.

Das Gericht befand im Weiteren: Eine schriftliche Einwilligung, die mehrere Sachverhalte betrifft – hier die Zustimmung zu den allgemeinen Geschäftsbedingungen der Klägerin – muss entsprechend den Vorgaben der DSGVO so gestaltet sein, dass die Einwilligung in die Verarbeitung personenbezogener Daten von den anderen Sachverhalten klar zu unterscheiden ist.11 Dies war vorliegend nicht der Fall. Bei Fehlen der nach § 7 Abs. 2 Nr. 2 UWG erforderlichen Einwilligung sei auch ein Rückgriff auf den Erlaubnistatbestand des Art. 6 Abs. 1 Satz 1 lit. f DSGVO (Interessenabwägung) nicht möglich.12 Es lag auch kein Ausnahmetatbestand nach § 7 Abs. 3 UWG vor. Diese Vorschrift setzt voraus, dass die Kund:innen bei der Erhebung und jeder weiteren Verwendung der Adresse „klar und deutlich“ darauf hingewiesen werden, dass sie der Verwendung jederzeit widersprechen können.13 Im vorliegenden Fall erfolgte der Hinweis zur Widerspruchsmöglichkeit erst unmittelbar nach einer Eigenwerbung der Klägerin am Ende der Anmeldeseite, sodass er leicht übersehen werden konnte und die vorgenannten Vorgaben des UWG nicht erfüllte.

Die Klägerin hat gegen das Urteil einen Antrag auf Zulassung der Berufung beim Oberverwaltungsgericht Berlin-Brandenburg gestellt. Eine Entscheidung steht noch aus.

E-Mail-Werbung auf der Grundlage einer pauschalen Zustimmung zu den AGB reicht für eine wirksame datenschutzrechtliche Einwilligung nicht aus: Die Einwilligung in die Verarbeitung personenbezogener Daten muss klar von den anderen Sachverhalten zu unterscheiden sein. Verantwortliche müssen bei E-Mail-Werbung auch im Datenschutzrecht die wettbewerbsrechtlichen Vorgaben aus § 7 Abs. 2 Nr. 2 und Abs. 3 UWG beachten (Einheit der Rechtsordnung), deren Nichteinhaltung zur Unzulässigkeit der Verarbeitung nach Art. 6 Abs. 1 Satz 1 DSGVO führt.

II. Bußgeldentscheidungen

1. Bußgeld wegen Sicherheitslücken in einer Praxismanagementsoftware

Wegen fehlender bzw. fehlerhaft implementierter Maßnahmen für die Gewährleistung eines angemessenen Schutzniveaus haben wir ein Bußgeld in Höhe von 60.000 Euro gegen einen Anbieter verhängt, der eine Plattform für das Management von Arztpraxen, medizinischen Versorgungszentren und Kliniken mit einem zugehörigen Gesundheitsportal zur Patientenkommunikation entwickelt hat und dieses betreibt. Die bei der Entwicklung der Plattformsoftware eingesetzten Mechanismen und Prozesse waren nicht ausreichend bzw. dysfunktional, um mögliche Datenschutz- und Sicherheitsrisiken systematisch abzuprüfen und dadurch Lücken zu detektieren. In der Umsetzung waren die Prozesse daher nicht geeignet, eine Webanwendung nach dem Stand der Technik zu gestalten.

Die Praxismanagementsoftware auf der Plattform des Unternehmens enthielt eine Reihe von Sicherheitslücken:

- Es war angemeldeten Patient:innen möglich, die E-Mail-Zugangsdaten einiger zugeordneter Arztpraxen einzusehen. In der Folge war der E-Mail-Zugang von insgesamt fünf ärztlichen Einrichtungen potenziell kompromittiert.

- Es war angemeldeten Patient:innen möglich, aufgrund fehlender Berechtigungsprüfungen und überflüssiger Softwarekomponenten Registrierungsdaten aller anderen Patient:innen einzusehen, u. a. deren IDs, die IDs der Arztpraxen, häufig E-Mail-Adressen und bei einigen Patient:innen auch deren vollständige Namen und Geburtsdaten. Hiervon waren insgesamt 29.495 Patient:innen mit Accounts im Gesundheitsportal betroffen.

- Bedingt durch die fehlenden Berechtigungsprüfungen waren umfangreiche Datensätze abrufbar, welche u. a. Dokumente aus dem Behandlungskontext, Blutwerte, Diagnosen, Konfigurationen aus den Praxen wie Client-Zertifikate für die Telematikinfrastruktur, Rechnungen sowie Laborergebnisse oder Krankschreibungen enthielten.

- Eine zur Übermittlung von Dokumenten von medizinischen Leistungserbringer:innen an Patient:innen eingesetzte, als Ende-zu-Ende-Verschlüsselung bezeichnete Sicherheitsmaßnahme enthielt einen Programmierfehler. Aufgrund des Fehlers war diese für Angreifer:innen, die den Datenverkehr innerhalb der eingesetzten TLS-Verbindung manipulieren können, für eine sog. Downgrade-Attacke nutzbar. Somit war es unberechtigten Dritten potenziell möglich, die versendeten Dokumente im Klartext einzusehen. Hiervon waren 198 Einrichtungen mit insgesamt 1.623.732 Patient:innen betroffen.

Für die Bußgeldzumessung haben wir die Leitlinien des Europäischen Datenschutzausschusses (EDSA) für die Berechnung von Geldbußen S. d. Datenschutz-Grundverordnung (DSGVO)14 angewendet. Bei der Zumessung berücksichtigten wir, dass mit den Daten Gesundheitsdaten15 gefährdet waren. Ein tatsächlicher Datenabfluss konnte aber nicht nachgewiesen werden. Bußgeldmindernd wurde eingestuft, dass sich die Verantwortliche in der Zusammenarbeit mit unserer Behörde kooperativ zeigte. Bis zur endgültigen Beseitigung der Sicherheitslücken wurden betroffene Systeme sofort abgeschaltet und ein umfangreicher Katalog an Maßnahmen identifiziert, die das Risiko für das künftige Auftreten gleichartiger Sicherheitslücken wirksam reduzieren sollen. Ebenfalls bußgeldmindernd wurde die zeitnahe Benachrichtigung aller Betroffenen bewertet.

Entwickler:innen und Anbieter:innen webbasierter Anwendungen im Gesundheitsbereich müssen bereits in der Konzeptionsphase systematisch etwaige Datenschutz- und Datensicherheitsrisiken der zu entwickelnden Systeme mitdenken. Hier bietet es sich an, die Methodik des Standard-Datenschutzmodells anzuwenden, um anhand der Gewährleistungsziele die datenschutzrechtlich erforderlichen technischen und organisatorischen Maßnahmen zur Gewährleistung eines angemessenen Schutzniveaus zu identifizieren. Diese Maßnahmen müssen sowohl während der Entwicklung als auch im laufenden Betrieb implementiert werden, um die Sicherheit der Verarbeitung gerade auch sensibler personenbezogener Daten zu garantieren. Kommt es aufgrund fehlender oder fehlerhaft implementierter Maßnahmen zu Sicherheitslücken, kann dies sanktioniert werden.

2. Missbräuchliche POLIKS-Abrufe

Ein großer Teil unserer Bußgeldverfahren betraf wieder Polizeibeamt:innen, die unbefugt, d. h. zu nicht-dienstlichen Zwecken, personenbezogene Daten von Dritten aus den polizeiinternen Datenbanken abgerufen und teilweise auch weiterverwendet haben.

Die Polizei nutzt ihre Datenbank POLIKS als Informationssystem für ihre gesetzlichen Aufgaben im Bereich der Strafverfolgung und der Gefahrenabwehr. In der Datenbank werden sowohl Vorgangsdaten als auch Daten von Beschuldigten, Straftäter:innen, Tatverdächtigen und Betroffenen sowie Daten von Opfern und Zeug:innen erfasst und gespeichert. Darunter befinden sich bspw. die vollständigen Namen, Geburtsdaten, Anschriften und Informationen zum Familienstand, aber auch Vorstrafen und Zeugenaussagen. Bedienstete der Polizei werden in regelmäßigen Abständen über die datenschutzrechtlichen Vorschriften informiert und darüber belehrt, dass es ihnen ausdrücklich untersagt ist, Daten aus POLIKS und anderen polizeilichen Informationssystemen für private Zwecke zu nutzen. Dennoch wird der Zugang zu POLIKS immer wieder dazu missbraucht, Daten zu nicht-dienstlichen Zwecken abzufragen.

In diesem Jahr haben wir 50 Verfahren gegen Polizeibeamt:innen eingeleitet und insgesamt 23 Bußgeldbescheide erlassen; u. a. in den folgenden Fällen:

- Eine Polizeibeamtin suchte während einer mehrjährigen Krankheit Dienststellen in Wohnortnähe auf, um dort systematisch Anfragen zu ihrem und dem sozialen Umfeld eines befreundeten Kollegen zu tätigen.

- Ein Polizeibeamter fragte nach Beendigung der Beziehung Daten zu seiner Ex-Freundin sowie diversen ihrer Familienmitglieder in insgesamt 170 Fällen ab.

- Ein Polizeibeamter, der selbst Opfer eines Diebstahls wurde, wollte durch Datenbankabrufe ein durch die brandenburgische Polizei geführtes Ermittlungsverfahren beschleunigen, indem er eigene Ermittlungen über POLIKS vornahm, obwohl er dienstlich für diese Ermittlungen nicht zuständig war.

- Ein Polizeibeamter speicherte die im Rahmen des Polizeidiensts erlangte private Telefonnummer einer Geschädigten, um mit ihr im Nachgang privat in Kontakt zu kommen.

- Ein Polizeibeamter fragte einen Vorgang ab, in dem er selbst als Täter geführt wurde, um so Einfluss auf das Verfahren nehmen zu können.

- Eine Polizeibeamtin stiftete einen Kollegen an, für sie eine private Abfrage zu tätigen.

- Ein Polizeibeamter fragte die Meldeadresse einer Person des öffentlichen Lebens ab, die später durch Dritte Drohschreiben erhielt. Ein Zusammenhang zwischen Drohschreiben und Abruf konnte allerdings nicht nachgewiesen werden.

Die fortwährenden missbräuchlichen Abrufe erfordern ein Gegensteuern durch ein erweitertes Schutzkonzept der Polizei. Auch wenn die bisher aufgedeckten Fälle des missbräuchlichen Datenabrufs im Verhältnis zur Gesamtzahl der polizeilichen Abfragen relativ gering erscheinen mögen, ist davon auszugehen, dass die tatsächliche Zahl der Missbrauchsfälle deutlich höher liegt. Denn die technischen Hürden für einen missbräuchlichen Zugriff sind nach wie vor niedrig und viele unberechtigte Abfragen bleiben vermutlich unentdeckt. Der bisherige Ansatz, Verstößen primär durch eine Anpassung der Weisungslage und verstärkte Kontrollen vorzubeugen, hat sich als unzureichend erwiesen. Mit momentan über 18.000 Bildschirmarbeitsplätzen und knapp 6.700 Mobilgeräten mit POLIKS-Apps16 ist POLIKS ein komplexes System, bei dem die beschriebenen organisatorischen Maßnahmen allein nicht ausreichen. Stattdessen müssen technische Lösungen in den Vordergrund rücken, die Datenschutzverstöße von vornherein erschweren oder verhindern.

Konkret sollten automatisierte Plausibilitätsprüfungen bei Datenabfragen implementiert werden, die ungewöhnliche Zugriffsmuster erkennen und bspw. bei gehäuften Abfragen zu einer Person automatisch Warnungen auslösen. Die Zugriffskontrolle sollte durch kürzere Abmeldefristen und eine durchgängige Zwei-Faktor-Authentifizierung an allen Arbeitsplätzen verschärft werden. Zudem ist eine dynamische Steuerung der Zugriffsrechte nötig – etwa durch temporäre Rechtevergaben nur für konkrete Vorgänge oder Inhalte und durch einen automatischen Rechteverfall nach Abschluss der Bearbeitung. Wir stehen dazu inhaltlich mit der Polizei im Austausch und mahnen strenge Maßstäbe u. a. bei Vor-Ort-Kontrollen an.

Unberechtigten Datenabrufen in POLIKS muss durch geeignete technische Maßnahmen wie Plausibilitätsprüfungen, kurze Abmeldefristen und Zwei-Faktor-Authentifizierung vorgebeugt werden. Wo diese Maßnahmen an ihre Grenzen stoßen, muss eine konsequente Sanktionierung greifen. Dazu gehören die systematische Aufdeckung von Verstößen durch automatisierte Auswertung der Protokolldaten und wirksame Stichprobenkontrollen. Einschränkungen der Zugriffsrechte für die Dauer der Überprüfung von Verdachtsfällen sollten dabei stets erwogen werden.

3. Kammergericht nach EuGH-Urteil: Sofortige Beschwerde im Verfahren gegen Deutsche Wohnen SE erfolgreich

Der Europäische Gerichtshof (EuGH) hatte im letzten Jahr unsere Aufsichtspraxis bestätigt und festgestellt, dass datenschutzrechtliche Bußgelder direkt gegen Unternehmen festgesetzt werden können. Laut EuGH haftet das Unternehmen auch für Verstöße, die von Personen begangen wurden, die im Rahmen der unternehmerischen Tätigkeit und im Namen dieser juristischen Person gehandelt haben.17 Dieser Ansicht ist nun auch das Kammergericht (KG Berlin) gefolgt.18 Dem Rechtsstreit liegt ein Bußgeldbescheid in Höhe von insgesamt 14,5 Mio. Euro zugrunde, den wir 2019 gegen die Deutsche Wohnen SE erlassen haben. Mit dem Beschluss des Kammergerichts wurde die Sache jetzt zu neuer Entscheidung an das Landgericht Berlin (LG Berlin) zurückverwiesen.

Das LG Berlin hatte 2021 unser Bußgeldverfahren gegen die Deutsche Wohnen SE wegen eines Verfahrenshindernisses eingestellt. Das Gericht ging davon aus, dass unsere Vorgehensweise – auch ohne eine konkrete Handlung von Leitungspersonen oder gesetzlichen Vertreter:innen darzulegen –, unmittelbar gegen die juristische Person als Betroffene (in diesem Fall die Deutsche Wohnen SE) vorzugehen, vom deutschen Ordnungswidrigkeitenrecht nicht gedeckt sei. Nachdem Rechtsmittel eingelegt wurden, hatte das Kammergericht das Verfahren ausgesetzt und Fragen zur Auslegung der DSGVO dem EuGH vorgelegt. Nach Durchführung des Vorabentscheidungsverfahrens und nach dem Urteil des EuGH hat das Kammergericht den Einstellungsbeschluss des LG Berlin nun aufgehoben.

Im Einklang mit der EuGH-Rechtsprechung19 stellte das Kammergericht fest, dass die Deutsche Wohnen SE als juristische Person taugliche Adressatin eines Bußgeldbescheides sein und als solche unmittelbar und nicht nur als Verfahrens- oder Nebenbeteiligte bebußt werden kann.20

Darüber hinaus stellte das Kammergericht klar, dass der Bußgeldbescheid die gesetzlichen Wirksamkeitsvoraussetzungen21 erfüllt. Im Bescheid seien die Vorwürfe „ausgesprochen konkret und ausführlich“ sowie die Tathandlungen „bemerkenswert und – gemessen an den vom EuGH formulierten materiell-rechtlichen Haftungsvoraussetzungen ersichtlich – überobligatorisch konkret“ dargestellt worden.22 Der Rechtsstreit über den Bußgeldbescheid wird nun beim LG Berlin weitergeführt. Dort wird die zuständige Kammer für Bußgeldsachen über den Einspruch der Deutsche Wohnen SE entscheiden.

Ist ein Datenschutzverstoß einer juristischen Person zurechenbar, muss der Bußgeldbescheid nicht bezeichnen, welche identifizierte natürliche Person gehandelt hat. Bußgeldverfahren können dann regelmäßig unmittelbar gegen die Unternehmen als Betroffene geführt werden, selbst wenn Leitungspersonen von dem konkreten Handeln ihrer Mitarbeitenden keine Kenntnis hatten.

4. Entscheidung des Landgerichts Berlin: Das Ignorieren einer Verwarnung kann sich bußgelderhöhend auswirken

Im Jahr 2022 hatten wir ein Bußgeld gegen ein Unternehmen wegen eines Interessenskonflikts eines betrieblichen Datenschutzbeauftragten innerhalb der Konzernstruktur eines E-Commerce-Konzerns verhängt.23 Die Person des betrieblichen Datenschutzbeauftragten war zugleich Geschäftsführer von zwei Dienstleistungsgesellschaften, die im Auftrag desjenigen Unternehmens personenbezogene Daten verarbeiteten, für welches er als Datenschutzbeauftragter benannt war. Diese von ihm geführten Dienstleistungsgesellschaften waren ebenfalls Teil des Konzerns, kümmerten sich um den Kundenservice und bearbeiteten die Bestellungen.

Das Unternehmen hatte Einspruch gegen unseren Bußgeldbescheid eingelegt. Das LG Berlin hat sich nun mit dem Fall befasst und in seiner Entscheidung24 zur Bemessung der Bußgeldhöhe Folgendes ausgeführt: Das LG Berlin schätzt die Schwere des von uns festgestellten Verstoßes anders als wir als gering ein, da keine besonders sensiblen Daten von dem Interessenskonflikt berührt waren. Betroffen waren nur allgemeine Kontaktdaten wie Namen, Adresse, Telefonnummer und E-Mail-Adresse, die von der Tochtergesellschaft im Auftrag des bebußten Unternehmens verarbeitet wurden.

Auch bezog sich das LG Berlin bei der Festlegung der Höhe des Bußgeldes auf eine vom LG Bonn getroffene Entscheidung25. So führte das LG Berlin aus, dass der Umsatz des Konzernverbunds als Bemessungsgröße bei einer, wie im vorliegenden Fall, eher geringen Schwere des Verstoßes eine nur untergeordnete Rolle spielt. Damit eine Geldbuße wirksam, abschreckend und verhältnismäßig ist,26 genügt es daher nach Auffassung des LG Berlin, dass die Nichtbeachtung der verletzten Vorschrift – aus Sicht des bebußten Unternehmens – aufgrund der angesetzten Summe gegenüber einem regelkonformen Verhalten als unwirtschaftlich erscheint.

Das LG Berlin hat allerdings den Umstand, dass unsere Behörde zuvor eine Verwarnung ausgesprochen hatte und dass trotz des darin enthaltenen ausdrücklichen rechtlichen Hinweises der Zustand nicht geändert wurde, schließlich bußgelderhöhend nach Art. 83 Abs. 2 e und i DSGVO gewertet.

Andauernde oder wiederholte Verstöße gegen datenschutzrechtliche Vorgaben können ein Zeichen für systematische Mängel sein, die eine (höhere) Geldbuße erfordern. Die Entscheidung des LG Berlin unterstreicht die Aufgabe von Unternehmen, Hinweisen und bestandskräftigen Abhilfemaßnahmen der Aufsichtsbehörden nachzukommen.

III. Informationsfreiheit

1. Anträge nach dem Informationsfreiheitsgesetz – Erhebung einer Postadresse

Das Bundesverwaltungsgericht (BVerwG) hat in einem Urteil festgestellt: Das Informationsfreiheitsgesetz des Bundes (IFG Bund) setzt voraus, dass die Behörde Kenntnis von der Identität desjenigen hat, der einen Antrag auf Informationszugang stellt. Zur Klärung der Identität darf die Behörde die Postanschrift des Antragstellers erheben, ohne dass darin ein Verstoß gegen die Datenschutz-Grundverordnung (DSGVO) zu sehen ist.

Dem Verfahren liegt eine Klage des Bundesministeriums des Inneren und für Heimat (BMI) gegen eine Verwarnung des Bundesbeauftragten für den Datenschutz und die Informationsfreiheit (BfDI) zugrunde.27 Hintergrund war eine Vermittlungsbitte eines Antragstellers, der beim BMI einen IFG-Antrag per E-Mail über die Plattform FragDenStaat gestellt hatte. Für die Beantwortung bestand das BMI auf der Übermittlung der Postanschrift und einer persönlichen E-Mail-Adresse des Antragstellers. Nach Übersendung der geforderten Daten teilte es dann per Post mit, dass keine Informationen zu der Anfrage vorliegen.

Laut BVerwG lag hier kein Datenschutzverstoß vor. Die mit der Verarbeitung der Postanschrift einhergehenden Datenverarbeitungsvorgänge seien rechtmäßig gewesen, da sie für eine Aufgabe erforderlich gewesen seien, die im öffentlichen Interesse liege und dem Verantwortlichen übertragen worden sei,28 namentlich der ordnungsgemäßen Bearbeitung der Bekanntgabe der abschließenden Entscheidung.29 Die erforderliche Rechtsgrundlage für die Verarbeitung30 sei in diesem Fall § 3 Bundesdatenschutzgesetz (BDSG) V. m. den Regelungen des IFG Bund.31 Zwar gebe es keine ausdrückliche Rechtsgrundlage zur Klärung der Identität des Antragsstellers im IFG Bund. Aus § 7 Abs. 1 IFG Bund lasse sich aber ableiten, dass zur sachgerechten Bearbeitung eines Antrags ersichtlich sein müsse, wer den Antrag stellt.32 Diese Schlussfolgerung ergebe sich aus dem vom IFG Bund vorgesehenen Prüfprogramm und zur Sicherstellung der Vollstreckung möglicher Gebühren.33 Das Gericht verweist zudem auf die Gesetzesbegründung, nach der die Behörde „im Einzelfall […] die Identität des Antragstellers feststellen können“ müsse.34

Die Informationsfreiheitsbeauftragten der Länder stellten im Rahmen der Konferenz der Informationsfreiheitsbeauftragten (IFK) zu der Entscheidung fest, dass die Erwägungen aus einem dort betreffenden Einzelfall (Bereich Bund) aufgrund der heterogenen Gesetzeslage nicht auf alle Länder übertragbar sind. Unabhängig davon waren sich die Informationsfreiheitsbeauftragten der Länder einig, dass durch die Formalisierung des Verfahrens, standardmäßig Postanschriften anzufordern, deutlich mehr Verwaltungsaufwand auch bei einfach zu beantwortenden Offenlegungsanträgen entstehen kann. Sie werden die informationspflichtigen Stellen weiterhin dahingehend beraten, Anträge niedrigschwellig, informationsfreundlich und damit unbürokratisch zu bearbeiten.

Auch für Berlin kann festgestellt werden, dass das Urteil des BVerwG, das sich auf das IFG Bund bezieht, nicht ohne Weiteres auf das Berliner Informationsfreiheitsgesetz (IFG) übertragbar ist. Rechtsgrundlage für die Verarbeitung personenbezogener Daten im Zusammenhang mit der Erfüllung des Informationszugangs ist in Berlin § 4a IFG und nicht § 3 BDSG in Verbindung mit den Regelungen des IFG Bund, wie es Gegenstand des Urteils des BVerwG war. Der Gesetzesbegründung zum IFG Berlin ist keinerlei Hinweis zu entnehmen, der eine allgemeine Pflicht zur Anforderung von Postadressen zur Identitätsfeststellung vor Antragsbearbeitung stützen könnte. Vielmehr betont die Begründung des Gesetzentwurfs die bürgerfreundliche Ausgestaltung des Verfahrens.

Richtigerweise gibt es Fälle, in denen eine Identifizierung von Antragstellenden auch mit Postadresse notwendig sein kann. In vielen Fällen wird dies aber nicht der Fall sein. Soweit es nicht erforderlich ist, werden wir daher weiterhin bei unserer Vermittlungstätigkeit sowie bei IFG-Anträgen an unser eigenes Haus darauf hinwirken, dass auf die Erfassung der Postadresse verzichtet wird, um eine bürgerfreundliche Bearbeitung zu gewährleisten. Damit wird auch verhindert, dass selbst bei einfach zu beantwortenden Offenlegungsanträgen deutlich mehr Verwaltungsaufwand entsteht.

Dem Haushaltsinteresse kann im Übrigen auch auf anderem Wege Rechnung getragen werden. So können Behörden von der Möglichkeit Gebrauch machen, dass Kosten bereits im Voraus beglichen werden.35 Im Rahmen unserer IFG-Vermittlungstätigkeit werden wir anderen informationspflichtigen Stellen in Berlin empfehlen, sich an diesen Maßstäben zu orientieren und im Rahmen des eingeräumten Ermessens für eine bürgerfreundliche Bearbeitung zu entscheiden.

Diese Einschätzung teilten wir auch der Senatsverwaltung für Inneres und Sport mit, die – ohne uns als für die IFG-Kontrolle zuständige Behörde einzubinden – in einem Rundschreiben an verschiedene Behörden vor dem Hintergrund des Urteils des BVerwG Hinweise „zur Verarbeitung des Namens und der Postanschrift der antragstellenden Person als personenbezogenes Datum nach § 4a IFG Berlin“ gegeben hatte. Darin weist die Innenverwaltung darauf hin, dass eine Erhebung der Postadresse möglich sei, macht aber nicht auf die Möglichkeit einer informationsfreundlicheren und unbürokratischeren Bearbeitung aufmerksam. Wir teilten der Senatsverwaltung mit, dass nach unserer Auffassung ein Name und eine E-Mail-Adresse ausreichend sein kann, um einen IFG-Antrag zu bearbeiten, und auch keine zwingende Verknüpfung von „Name und Postanschrift“ bei der Identitätsfeststellung erforderlich ist. Bei der Senatsverwaltung haben wir einen Austausch in der Sache angeregt und unsere Unterstützung bei der Anpassung des Rundschreibens angeboten.

Das Urteil des BVerwG bezieht sich auf das IFG Bund und nicht auf die Regelungen im IFG Berlin. Der Gesetzesbegründung zum IFG Berlin ist keinerlei Hinweis zu entnehmen, der eine allgemeine Pflicht zur Anforderung von Postadressen zur Identitätsfeststellung vor Antragsbearbeitung stützen könnte. Wir werden weiterhin grundsätzlich keine Postanschrift für die IFG-Antragsstellung fordern, wenn dies zur weiteren Bearbeitung nicht erforderlich ist. Eine Erforderlichkeit kann bspw. gegeben sein, weil eine antragstellende Person nicht von der Möglichkeit Gebrauch machen möchte, Kosten bereits im Voraus zu begleichen, und daher die Zustellung eines Gebührenbescheids erforderlich ist. Oder es bestehen Zweifel an der Identität einer antragstellenden Person, aber die zweifelsfreie Feststellung ist im Einzelfall zur Prüfung von Ausschlussgründen (bspw. zum Schutz von personenbezogenen Daten Dritter) erforderlich. Im Rahmen der Vermittlungstätigkeit werden wir anderen informationspflichtigen Stellen in Berlin ebenfalls empfehlen, sich im Rahmen ihres Ermessens für eine bürgerfreundliche Bearbeitung der Anträge ohne Erhebung der Postanschrift zu entscheiden.

2. Gemeinsam die Informationsfreiheit und das Transparenzrecht stärken

Sinn und Zweck des IFG ist neben der Kontrolle staatlichen Handelns auch die Förderung der demokratischen Meinungs- und Willensbildung.36 Zivilgesellschaftliche Organisationen spielen dabei eine wichtige Rolle. Um dem Rechnung zu tragen und voneinander zu lernen, organisierten wir ein Auftakttreffen mit zivilgesellschaftlichen Organisationen zum Meinungsaustausch über die Informationsfreiheit und das Transparenzrecht.

Mit Vertreter:innen von Mehr Demokratie e. V., der Open Knowledge Foundation Deutschland e. V. und der Regionalgruppe Berlin-Brandenburg von Transparency International Deutschland e. V. diskutierten wir dabei auf Fachebene über folgende Themen:

- die bereits seit Längerem angedachte Weiterentwicklung des Berliner Informationsfreiheitsgesetzes zu einem Transparenzgesetz

- das Thema Aktenführung bei Behörden

- die auch im vorliegenden Jahresbericht thematisierte Entscheidung des BVerwG zur Datenverarbeitung der Anschrift von Antragstellenden nach dem IFG Bund37

Ebenfalls diskutierten wir über unsere Erfahrungen in der Bildungsarbeit mit Kindern und Jugendlichen im Bereich Datenschutz und Informationsfreiheit. Durch dieses Auftakttreffen konnten wir wichtige Impulse für unsere Arbeit mitnehmen. Um das kollektive Wissen verschiedener Akteur:innen noch besser nutzen zu können, wünschen wir uns für die Zukunft eine Erweiterung des Kreises der Teilnehmenden.

Die Weiterentwicklung und das Wirksamwerden von Informationsfreiheit und Transparenzrecht kann nur mit einem lebendigen Austausch verschiedener Gruppen gelingen. Wir sind offen für Ideen aus der Zivilgesellschaft und von anderen Akteur:innen. Langfristig ist ein regelmäßiger Informationsaustausch angedacht, sowohl mit Vertreter:innen der Zivilgesellschaft als auch mit anderen Stakeholdern in diesem Bereich, die sich in Berlin für die Informationsfreiheit und das Transparenzrecht einsetzen.

3. Schnelle Bearbeitung von IFG-Anträgen

In diesem Jahr ist es uns ein besonderes Anliegen, auf ein Thema aufmerksam zu machen, das uns auch nach 25 Jahren der Geltung des IFG im Land Berlin immer wieder beschäftigt. Es handelt sich um Schwierigkeiten bei der Umsetzung der gesetzlich normierten Pflicht, über IFG-Anträge unverzüglich zu entscheiden.38

Unverzüglich bedeutet „ohne schuldhaftes Zögern“.39 Dies erfordert ein Tätigwerden innerhalb einer nach den Umständen des Einzelfalls zu bemessenden zumeist kurzen Prüfungs- und Überlegungsfrist.40

Daher müssen sich Verwaltungen nach Eingang unmittelbar mit einem IFG-Antrag befassen. Regelmäßig bedeutet dies, sich der Bitte um Kostenvorabinformation anzunehmen, die inzwischen standardmäßig in Anträgen formuliert wird. Naheliegenderweise ist hierzu erforderlich, dass zunächst der Umfang der angefragten Informationen hausintern geklärt wird, woraufhin eine realistische, aber nicht prohibitiv wirkende Kostenschätzung vorzunehmen ist. Nach Kostenübernahmeerklärung der antragstellenden Person ist mit der detaillierten Prüfung der gewünschten Dokumente auf mögliche IFG-Ausschlusstatbestände41 zu beginnen und ggf. Anhörungsverfahren mit Betroffenen durchzuführen.42 Kann über einen Antrag nicht schon innerhalb von zwei Wochen abschließend entschieden werden, sollte der antragstellenden Person eine Eingangsbestätigung geschickt werden.43

Die Wirklichkeit der Berliner Verwaltung sieht häufig anders aus. Das merken wir an den Beschwerden, die wir wegen zögerlicher Bearbeitung erhalten und bei denen wir tätig wurden; manchmal unter Hinweis auf eine drohende Untätigkeitsklage44 gegen das Land Berlin, die es zu vermeiden gilt. So erhielten Beschwerdeführer:innen nach Antragstellung von informationspflichtigen Stellen über einen längeren Zeitraum keine Antwort, z. T. trotz Erinnerungen auch keine Eingangsbestätigung. Eine späte Antwort begründete eine Verwaltung bspw. mit „der seit längerer Zeit anhaltenden hohen Arbeitsbelastung im Zusammenhang mit der Digitalisierung im Öffentlichen Gesundheitsdienst“. In einer weiteren Antwort, die eine Verwaltung nach unserer Intervention dem Beschwerdeführer ca. sieben Wochen nach Antragstellung schickte, wurde um mehr Zeit für die Prüfung gebeten. Es würde versucht, sich nach den Urlaubstagen zeitnah darum zu kümmern.

Es zeigt sich insgesamt, dass die Bearbeitung von IFG-Anträgen in einigen Verwaltungen noch immer hintangestellt und nicht als eigenständige öffentliche Aufgabe verstanden wird. In einem Fall wurde ein Antrag sogar ausdrücklich als belästigend tituliert.45 Trotz angespannter Personalsituation darf nicht verkannt werden, dass angefragte Behörden grundsätzlich gehalten sind, sich in ihrer Arbeitsorganisation und Aktenführung auf die mit der Erfüllung von IFG-Anträgen verbundenen Aufgaben einzustellen. Die Bearbeitung solcher Anträge sollte im Land Berlin 25 Jahre nach Inkrafttreten des Gesetzes von 1999 als originäres Aufgabengebiet von den informationspflichtigen Stellen betrachtet und behandelt werden.46

Die Behörden, insbesondere deren Leitungen, müssen ihre Organisations- und Personalstrukturen so ausrichten, dass sie neben ihren eigentlichen Sachaufgaben auch die gesetzlichen Pflichten nach dem IFG erfüllen können. Verfahrensabläufe können gerade in großen Verwaltungen dadurch gestrafft werden, dass IFG-Anträge nicht an die allgemeinen Poststellen, sondern an eigens eingerichtete Funktionsadressen geschickt werden, die im Internetangebot der informationspflichtigen Stellen abrufbar sind.

4. Akteneinsicht in bezirkliche Bauakten

In diesem Jahr erreichten uns mehrere Beschwerden, weil einige Bezirke die nach dem IFG beantragten Akteneinsichten in Bauakten abgelehnt oder von nicht IFG-konformen Voraussetzungen abhängig gemacht hatten. In den Verfahren zeigten sich erhebliche Unsicherheiten bei der Anwendung des IFG.

So beantragte eine Person den Zugang zu Informationen aus historischen Bauakten im Bezirksamt Steglitz Zehlendorf. Das Interesse galt der Zeit von 1930 bis 1940 und bezog sich auf die Klärung von Baujahr, historischen Adressen und Bauherren von zunächst 30 Gebäuden. Das zuständige Amt verlangte vor einer Einsichtnahme in die archivierten Grundstücksakten standardmäßig die Vorlage einer Vollmacht der aktuellen Eigentümerin bzw. des aktuellen Eigentümers; wer das jeweils war, war der antragstellenden Person nicht bekannt. Später stellte sich heraus, dass die gewünschten Informationen den jeweiligen Baugenehmigungen zu entnehmen waren. Wir konnten das Amt davon überzeugen, dass die Beibringung von Vollmachten bzw. Anhörung der Betroffenen nicht erforderlich ist, und begründeten dies unter Bezugnahme auf die neuere Rechtsprechung zu Umweltinformationen. Zu solchen Informationen gehören grundsätzlich Baugenehmigungen für Gebäude, weil mit ihnen eine Baumaßnahme freigegeben wird, die sich aufgrund der Versiegelung des Bodens wahrscheinlich nachteilig auf die Umwelt auswirkt.47 Dass durch die Offenbarung der 80 bis 90 Jahre alten Baugenehmigungen Interessen von aktuellen Eigentümerinnen oder Eigentümern erheblich beeinträchtigt würden, war fernliegend. Deshalb handelte es sich nicht um geschützte Informationen, sodass die Anhörung der vorgenannten Personen entfiel.48 Die antragstellende Person konnte schließlich die Akteneinsichten vor Ort gebührenfrei wahrnehmen.49

Ein weiterer Fall im Bezirksamt Steglitz-Zehlendorf betraf Informationen zu einer Baugenehmigung für den Dachgeschossausbau in einem denkmalgeschützten Gebäude. Das Amt teilte der antragstellenden Person mit, dass sie entweder die Vollmacht der Grundstückseigentümerin (eine GmbH) vorlegen oder das Amt die Anhörung der GmbH durchführen müsse. Wir haben dem Amt mitgeteilt, dass hier personenbezogene Daten nicht berührt sind und demzufolge eine Anhörung der GmbH allenfalls wegen schützenswerter Betriebs- oder Geschäftsgeheimnisse50 durchzuführen wäre. Da auch solche nicht begründet werden konnten, erhielt die antragstellende Person schließlich die beantragten Kopien der den Bau betreffenden Dokumente.

Im Bezirksamt Treptow-Köpenick hatte eine Person Einsicht in die Baugenehmigung des Nachbarn beantragt. Der Informationszugang war zunächst gestattet und ein Termin zur Einsichtnahme vereinbart worden. Zu dem Bauvorhaben gehörte der Bau einer Tiefgarage mit vermuteten Auswirkungen auf den Grundwasserspiegel. Die antragstellende Person befürchtete dadurch Beschädigungen des Mauerwerks des eigenen Gebäudes und sah sich durch vom Bauherrn angebrachte sog. Rissmarker darin bestärkt. Da der Bauherr nach Anhörung die Zustimmung zur Einsichtnahme verweigerte, wurde der diesbezüglich anberaumte Termin vom Amt kurzfristig aufgehoben. Die antragstellende Person erhielt jedoch später alle gewünschten Informationen, einschließlich derjenigen von der Wasserbehörde. Eine erhebliche Beeinträchtigung der Interessen des Bauherrn durch die Offenlegung der personenbezogenen Informationen war nicht erkennbar.

Einige Unruhe wurde im Bezirksamt Mitte verursacht, weil dort ein Papier kursierte, mit dem der Umgang mit Anträgen von Studierenden auf Akteneinsicht in Bauakten festgelegt werden sollte. Danach war Voraussetzung für die Bearbeitung u. a. ein von der betreuenden Professorin bzw. dem betreuenden Professor unterzeichnetes Schreiben der Hochschule, das etwa Angaben zur Matrikelnummer der bzw. des Studierenden und Angaben zum Thema der Studienarbeit als Nachweis des berechtigten Interesses enthalten sollte. Sofern ein solches Schreiben beigebracht wurde, sollte auf die Anhörung der jeweiligen Grundstückseigentümerin oder des jeweiligen Grundstückseigentümers verzichtet werden. Diese Voraussetzungen waren aus dem IFG nicht herleitbar. Auch war keine Rechtsgrundlage für die Verarbeitung von für den Antrag nicht erforderlichen personenbezogenen Daten der antragstellenden Studierenden erkennbar. Wir haben das Amt daher gebeten, das Verfahren in der Praxis nicht anzuwenden.

Eine Person begehrte vom Bezirksamt Charlottenburg-Wilmersdorf Informationen zu mehreren Werbeanlagen, die in einem Fall auf einem Privatgrundstück, im zweiten Fall im öffentlichen Straßenland angebracht waren. Im ersten Fall ging es um eine Baugenehmigung, für die das Stadtentwicklungsamt zuständig ist. Die Akteneinsicht im Bauaktenarchiv wurde zunächst davon abhängig gemacht, dass die antragstellende Person ein Formular ausfüllt, in dem zutreffende Angaben anzukreuzen waren.51 Auf unser Tätigwerden wurde eingeräumt, dass ein IFG-Antrag formlos gestellt werden kann. Das Formular würde aus organisatorischen Gründen genutzt, um die Terminierung vornehmen und über die Gebührenpflicht aufklären zu können. Die antragstellende Person hat schließlich die gewünschten Informationen erhalten, denn gesetzliche Ausschlussgründe lagen nicht vor.

Im zweiten Fall ging es um eine Sondernutzungserlaubnis, für die das bezirkliche Straßen- und Grünflächenamt zuständig ist. Hier wurde der Antrag zunächst mit der pauschalen Begründung abgelehnt, der Sondernutzer habe die Akteneinsicht durch Darlegung von Gründen abgelehnt. Seine Anhörung hätte allerdings vorausgesetzt, dass eine der genannten Tatbestandsvoraussetzungen (personenbezogene Daten bzw. Betriebs- oder Geschäftsgeheimnisse) vom Amt bejaht wurde und zusätzlich die gesetzlich vorgesehene Interessenabwägung erfolgt ist.52 Dass hiernach der Verwaltungsvorgang in Gänze nach IFG schutzbedürftig und deshalb auch kein teilweiser Informationszugang (bei Schwärzung schutzbedürftiger Daten)53 möglich sein sollte, war nicht nachvollziehbar. Nach unserer Intervention hat das Amt dem Widerspruch abgeholfen und den Informationszugang erteilt.

Die Beschwerden machen deutlich, dass in den Bezirken eine Vereinheitlichung der Akteneinsichtsverfahren erstrebenswert ist, denn die beschriebenen Fälle zeichneten sich auch dadurch aus, dass sich die beschwerdeführenden Personen bei gleicher Sachlage mit unterschiedlichen Vorgehensweisen in den Bezirken konfrontiert sahen. Wir haben uns daher zunächst einen Eindruck verschafft, welche Art von Bauakten und Daten in den Ämtern verarbeitet wird. Gemeinsam mit der Senatsverwaltung für Stadtentwicklung, Bauen und Wohnen als Oberste Bauaufsichtsbehörde haben wir einen Termin im Bezirksamt Charlottenburg-Wilmersdorf wahrgenommen, wo uns exemplarisch einige Akten aus dem Bauamt bzw. dem Bauaktenarchiv und diesbezügliche Akteneinsichtsanträge gezeigt wurden. Auch das Bauaktenarchiv selbst haben wir besichtigt. Denn wer es nicht gesehen hat, vermag nicht zu ermessen, welche umfangreichen grundstücksbezogenen Papierdokumentationen dort vorgehalten werden, auf die sich zahlreiche und immer wiederkehrende Akteneinsichtsgesuche beziehen. Sie werden z. B. von Bauhistoriker:innen als wahre Datenschätze angesehen. Deshalb ist es wichtig, dass Akteneinsichtsverfahren möglichst straff und informationszugangsfreundlich gestaltet werden und gleichzeitig die Rechte derjenigen gewahrt bleiben, deren Interessen von den Zugangsanträgen berührt sind.

Die Senatsverwaltung für Stadtentwicklung, Bauen und Wohnen beabsichtigt, zur Vereinheitlichung der bezirklichen Verfahren bei Akteneinsichten in Bauakten Vorschriften zu erarbeiten. Daraus sollen sich die spezifischen Handlungsbefugnisse für die Beschäftigten ergeben, je nachdem, zu welchen Zwecken Antragsteller:innen (wie bspw. Forschende und Architekt:innen) Akteneinsicht nehmen wollen und um wessen u. U. schutzbedürftige Daten (z. B. der Bauherr:innen) es geht. Dadurch würde die antragsgemäße Offenlegung von Informationen aus bezirklichen Bauakten nach einheitlichen und für Antragsteller:innen nachvollziehbaren Kriterien erfolgen. Wir werden uns hier aus Sicht der Informationsfreiheit und aus Sicht des Datenschutzes einbringen. Die Kriterien könnten auch ein wichtiger Schritt zur Digitalisierung der Bauakten sein, die auf der Grundlage eines ggf. zukünftig existierenden Berliner Transparenzgesetzes in einem Transparenzregister zu veröffentlichen wären.

Wir begrüßen die von der Obersten Bauaufsicht beabsichtigte Vereinheitlichung des datenschutzkonformen Informationszugangs zu Bauakten, und zwar sowohl im Hinblick auf Individualanträge als auch im Hinblick auf eine mögliche spätere proaktive Veröffentlichung in einem Transparenzregister. Durch die antragsunabhängige Bereitstellung der Informationen würde letztlich auch der Personalaufwand vermieden, der durch die Bearbeitung von Einzelanträgen entsteht.

5. Informationsfreiheit und Datenschutz

a) Eine Person beschwerte sich bei uns darüber, dass ihr IFG-Antrag auf Offenlegung eines gerichtlichen Vergleichs zwischen einer Universität und einem ihrer Professoren samt allen damit zusammenhängenden Akten vom Gericht abgelehnt worden war. Zur Begründung hatte das Gericht angeführt, dass ein Vergleich gewissermaßen ein „Vertrag“ zwischen den Parteien sei, dessen Inhalt nicht für Dritte bestimmt ist.

Wir haben der Person mitgeteilt, dass wir das Anliegen in unserer Funktion als IFG-Schiedsstelle54 nicht unterstützen können. Bei dem Prozessvergleich handelt es sich um eine Entscheidung in richterlicher Unabhängigkeit und nicht um eine Verwaltungstätigkeit des Gerichts. Nur für letztere Tätigkeiten eines Gerichts ist das IFG anwendbar.55 Zudem würde die Offenlegung des gewünschten Dokuments inklusive der dem Vergleich zugrunde liegenden Unterlagen eine Übermittlung der personenbezogenen Daten des Professors darstellen. Dies wäre auch bei Anwendbarkeit des IFG nicht vom Gesetz gedeckt: Das IFG lässt nur in den explizit genannten wenigen Fällen eine Offenlegung von personenbezogenen Daten ohne Zustimmung des Betroffenen zu.56

b) Eine Person beschwerte sich bei uns darüber, dass die Feuerwehr weder auf den IFG-Antrag noch in der Einsatzberichterstattung im Internet Einzelheiten zu einer Brandbekämpfung mitteilte, die in einer konkret benannten Mietwohnung eines Wohnhauses stattgefunden hatte. Für die Person war dies unverständlich, denn sie fühlte sich als im selben Haus lebende Mieterin ebenfalls vom Brand betroffen. Später beantragte sie die Auskunft über alle Einsätze der Feuerwehr, die an dem besagten Tag in Berlin erfolgt waren. Da die Feuerwehr darauf nicht reagierte, beschwerte sich die Person erneut.

Wir haben der Person mitgeteilt, dass wir ihr Anliegen in unserer Funktion als IFG-Schiedsstelle nicht unterstützen können. Denn auf der Grundlage des IFG bestand kein Anspruch, dass ihr die gewünschten Einzelheiten zu dem konkreten Einsatz mitgeteilt werden. Nach dem IFG besteht das Recht auf Aktenauskunft u. a. nicht, soweit dadurch personenbezogene Daten veröffentlicht werden und tatsächliche Anhaltspunkte dafür vorhanden sind, dass überwiegend Privatinteressen verfolgt werden.57 Dies war hier der Fall, denn die gewünschten Informationen zum Feuerwehreinsatz in der konkret benannten Straße mit Hausnummer und Lage („parterre, links“) sowie die konkreten Einsatzdetails waren personenbezogen. Ein überwiegendes Informationsinteresse, das sich auf die Kontrolle staatlichen Handelns bezieht,58 war nicht ersichtlich.

Die nachfolgende Beschwerde derselben Person über die Untätigkeit der Feuerwehr in Bezug auf ihren zweiten (allgemeiner formulierten) Antrag zielte erkennbar darauf ab, nun auf diese Art Einzelheiten zu dem Feuerwehreinsatz zu erfahren. Wir teilten der Person daher mit, dass wir das Anliegen nicht unterstützen können. Auch die Feuerwehr dazu zu bewegen, den IFG-Antrag förmlich zu bescheiden, hätte bedeutet, dass wir dies mit einem Hinweis auf unsere Rechtsauffassung verbinden.59 Danach wäre die Offenlegung der gewünschten Informationen aus den dargestellten Gründen unzulässig gewesen.

Informationszugang und Datenschutz schließen sich nicht aus: Es handelt sich um zwei Seiten derselben Medaille, denn beides kann in Einklang gebracht werden, wie sich aus der Abwägung des Gesetzgebers in den Fällen des § 6 IFG ergibt. Für die Offenlegung von personenbezogenen Daten, die über die im Gesetz genannten Fälle hinausgehen, besteht regelmäßig keine Rechtsgrundlage.

IV. Künstliche Intelligenz

1. Künstliche Intelligenz in der Berliner Verwaltung

Im April fand das Kick-off-Treffen der neu gegründeten Taskforce KI statt. Die Taskforce wird von der Senatskanzlei und dem IT-Dienstleistungszentrum Berlin (ITDZ) gemeinsam geleitet und befasst sich mit Projekten der Verwaltung zu Künstlicher Intelligenz (KI). Ein erstes Arbeitsergebnis ist eine Orientierungshilfe zum Umgang mit auf großen Sprachmodellen basierten Chatbots (LLM-basierte Chatbots)60 für Verwaltungsmitarbeitende. Wir bringen uns mit juristischer sowie technischer Expertise ein.

Nach dem Haushaltsgesetz 2024/25 ist die Berliner Verwaltung aufgefordert, eine Taskforce KI einzurichten. Sie soll die aktuellen Entwicklungen im Bereich Künstlicher Intelligenz beobachten, bewerten und Empfehlungen für den weiteren Umgang und die Nutzung von KI-Anwendungen im Land Berlin geben. Dazu haben sich verschiedene Akteur:innen aus den Hauptverwaltungen, der Wissenschaft, dem CityLab (Berlins öffentliches Innovationslabor) und dem ITDZ mehrmals in diesem Jahr getroffen. Wir haben uns ebenfalls eingebracht. Aufgabe der Taskforce wird es künftig sein, Beratung für die Verwaltung z. B. durch die Erarbeitung von Handlungsempfehlungen und Leitfäden anzubieten, ressortübergreifende KI-Vorhaben und zukünftige Pilotprojekte zu begleiten sowie den Wissenstransfer zu fördern.

Erste Arbeitsergebnisse der Taskforce KI sind die im September veröffentlichte Orientierungshilfe zum Umgang mit LLM-basierten Chatbots im Land Berlin sowie der Leitfaden für effektives Prompting61. Beide Dokumente hat die Senatskanzlei als Anlagen zu einem Rundschreiben zum Umgang mit generativen KI-Anwendungen in der Verwaltung veröffentlicht.62 Die Handlungsanleitungen richten sich an Führungskräfte sowie Verwaltungsmitarbeiter:innen, die auf dem Markt verfügbare KI-Chatbots nutzen, und geben Hinweise zum verantwortungsbewussten Umgang damit. Gleichzeitig dienen sie der Sensibilisierung für die rechtlichen Rahmenbedingungen. Wir haben uns bei der Erarbeitung der Orientierungshilfe beteiligt und die datenschutzrechtlichen Aspekte eingebracht.

Ferner haben wir die Teilnehmenden der Taskforce KI zu datenschutzrechtlichen Fragestellungen im Zusammenhang mit der Entwicklung und dem Einsatz von KI sensibilisiert. So gelten die Vorschriften der Datenschutz-Grundverordnung (DSGVO), wenn personenbezogene oder personenbeziehbare Daten verarbeitet werden. Sollen KI-Systeme mit personenbezogenen Daten trainiert werden, obwohl diese nicht zum Training, sondern für einen anderen Zweck erhoben wurden, bedarf es hierfür einer separaten (noch zu schaffenden) Rechtsgrundlage. Zum einen scheidet eine Verarbeitung personenbezogener Daten auf der Grundlage eines berechtigten Interesses S. d. Art. 6 Abs. 1 Satz 1 lit. f DSGVO im öffentlichen Bereich als Rechtsgrundlage aus.63 Zum anderen ist fraglich, ob gegenüber der Verwaltung erteilte Einwilligungen wirksam sein können. Ob und welche Folgen es hat, wenn ein KI-Modell mit personenbezogenen Daten trainiert wurde und die Rechtmäßigkeit der Datenverarbeitung in der Trainingsphase zweifelhaft ist, muss im Rahmen einer Risikoprüfung im Einzelfall analysiert werden.

Die Einordnung, dass KI-Modelle nicht generell als anonym angesehen werden, sondern personenbezogene Daten enthalten können,64 wirft für die Verwaltung noch zu klärende Fragen hinsichtlich der Zulässigkeit des Einsatzes verschiedener gängiger KI-Modelle auf. Die Verwaltung benötigt für die datenschutzkonforme Entwicklung und den datenschutzkonformen Einsatz von KI-Modellen Unterstützung in Form konkreter Lösungsansätze.

Zukünftig wird sich die Taskforce KI vor allem mit konkreten KI-Projekten im Land Berlin befassen. Angesichts der hohen Datenschutzrelevanz des Einsatzes von KI-Anwendungen für Bürger:innen und Beschäftigte werden wir uns weiterhin in der Taskforce KI dafür einsetzen, dass der Schutz personenbezogener Daten von vornherein Berücksichtigung findet. Hierfür soll innerhalb der Taskforce eine Unterarbeitsgruppe zum Datenschutz eingerichtet werden, an der interessierte Verwaltungsvertreter:innen mitwirken können. Unabhängig davon werden wir – sowohl in Abstimmung mit den übrigen deutschen als auch mit den europäischen Aufsichtsbehörden – auf Klärung bisher ungeklärter Rechtsfragen hinwirken und Vorschläge für konkrete Lösungsansätze erarbeiten.

2. Erste Erkenntnisse aus großen Prüfverfahren zu Künstlicher Intelligenz

Die Überwachung und die Durchsetzung der DSGVO im KI-Bereich findet mehr und mehr Eingang in unsere alltägliche Aufsichtspraxis. In ersten Prüfverfahren von Amts wegen im nicht-öffentlichen Bereich haben wir bereits einige Datenschutzverstöße ausmachen können, die es in der Zukunft zu vermeiden bzw. abzustellen gilt.

Die praktischen Einblicke in die KI-Anwendungsszenarien einiger Unternehmen haben erste Problemstellungen aufgezeigt. Hier ging es zumeist um Techniken des maschinellen Lernens, die häufig eine große Anzahl personenbezogener Trainingsdaten voraussetzen. Sowohl das Training der KI-Modelle als auch der Einsatz der auf den KI-Modellen basierenden KI-Systeme können dabei datenschutzrechtliche Relevanz aufweisen. Inhaltlich haben wir uns zunächst auf die wesentlichen Fragen der Rechtsgrundlage für die Verarbeitung von personenbezogenen Daten bei der Entwicklung und dem Einsatz von KI65 sowie auf die dazugehörige Transparenz gegenüber den betroffenen Personen66 konzentriert.

Die DSGVO geht von deterministischen Verarbeitungssystemen aus, d. h. es gibt konkrete Zwecke für die Verarbeitung, an der die Erforderlichkeit der personenbezogenen Datenverarbeitung gemessen werden kann. Bei der Verwendung von KI-Modellen und -Systemen haben wir es aber regelmäßig mit Mitteln zu tun, die einen probabilistischen Ansatz verfolgen: Sie beruhen auf Wahrscheinlichkeiten und nicht auf gänzlich vorgefertigten Regeln, was die Entdeckung von Zusammenhängen in verschiedensten Anwendungsbereichen ermöglicht. Die Verwendungszwecke von personenbezogenen Daten im KI-Kontext können daher sehr allgemein bzw. unspezifisch sein, d. h. so unspezifisch, dass die KI nicht als Verarbeitungsmittel zur Erreichung eines bestimmten Zwecks zu betrachten ist, sondern etwa beim Einsatz generativer KI zum Selbstzweck wird. Vor diesem Hintergrund fehlt es ggf. an der Beziehung zwischen Zweck und Verarbeitung, die bisher den Rahmen für die Erforderlichkeitsprüfung setzt. Darüber hinaus werden ggf. Daten verwendet, die zu einem anderen Zweck erhoben wurden und nun zweckändernd für das Training von KI-Modellen bzw. -Systemen eingesetzt werden sollen. Wie bei der Datenerhebung zum Zwecke des KI-Trainings bedarf es auch für die zweckändernde Weiterverarbeitung von Daten zu diesem Zweck einer Rechtsgrundlage und die Anforderungen des Zweckvereinbarkeitstests des Art. 6 Abs. 4 DSGVO müssen erfüllt sein.

Im nicht-öffentlichen Bereich kann als Rechtsgrundlage Art. 6 Abs. 1 Satz 1 lit. f DSGVO herangezogen werden. Danach ist die Rechtmäßigkeit davon abhängig zu machen, dass die Verarbeitung zur Wahrung der berechtigten Interessen des Verantwortlichen oder eines Dritten erforderlich ist und keine schutzwürdigen Interessen oder Grundrechte und Grundfreiheiten der betroffenen Personen überwiegen.67 Im Rahmen dieser Interessenabwägung kann die Verarbeitung von Trainingsdaten auch risikoabhängig untersucht werden. Dabei wäre Folgendes zu berücksichtigen:

- ob vor dem Hintergrund der Datenminimierung eine Verarbeitung mit anonymisierten bzw. pseudonymisierten Daten ausreichend sein kann

- in welchem Kontext die Datenverarbeitung erfolgt

- welche Konsequenzen die Datenverarbeitung für die betroffenen Personen hat bzw. ob abschätzbar ist, welche Konsequenzen sie haben kann

- ob es sich um Daten handelt, die von dem Unternehmen direkt bei der betroffenen Person erhoben oder von Dritten beschafft wurden

- welche Art von Daten in welcher Intensität verarbeitet werden

- welche Schutzbedarfe die personenbezogene Datenverarbeitung hat

- welche Erwartungshaltung die betroffenen Personen in Bezug auf die Verarbeitung ihrer Daten haben

- welche Einwirkungsmöglichkeiten auf die Verarbeitung den betroffenen Personen zur Verfügung stehen

Auffällig war bei unseren Prüfungen, dass viele Unternehmen die betroffenen Personen bisher entweder gar nicht oder nicht ausreichend über ihre Datenverarbeitung im Zusammenhang mit ihren KI-Systemen informieren. Dies kann auch für die Frage der Rechtmäßigkeit der Datenverarbeitung unmittelbare Konsequenzen haben. Gerade wenn sich Verantwortliche auf die Verarbeitung personenbezogener Daten zur Wahrung berechtigter Interessen68 berufen, gehen wir nach der EuGH-Rechtsprechung69 davon aus, dass dies unzulässig ist, wenn betroffenen Personen nicht einmal das berechtigte Interesse70 mitgeteilt wird, auf das sich der Verantwortliche beruft. Dieser Verstoß gegen die Mitteilungspflichten nach Art. 13 bzw. Art. 14 DSGVO wirkt sich dann unmittelbar auf die Rechtmäßigkeit der Datenverarbeitung aus. Unabhängig davon kann eine über die gesetzlichen Vorgaben herausgehende Transparenz gegenüber den betroffenen Personen (z. B. durch eine Zusammenstellung häufig gestellter Fragen (FAQ) zu den KI-Systemen) ein wichtiger Faktor bei der Prüfung der Zulässigkeit im Rahmen der Interessenabwägung71 sein.

Insofern haben wir den Eindruck gewonnen, dass viele Unternehmen unabhängig von ihrer Größe aufgrund des derzeitigen KI-Enthusiasmus erste Schritte mit KI-Systemen wagen, ohne dabei die etablierten Compliance-Prozesse für den Datenschutzbereich einzuhalten. Vielfach haben wir bspw. KI-Chatbots auf Websites ohne Informationen zur damit einhergehenden Verarbeitung personenbezogener Daten vorgefunden. Bei einem Unternehmen, das ein KI-basiertes Forderungsmanagement anbietet, haben wir vor Ort überprüft, ob hinsichtlich seiner KI-Modelle die vorgebliche Anonymisierung der Daten der Schuldner:innen vor dem bestärkenden Lernen (sog. Reinforcement Learning) tatsächlich als wirksam einzustufen ist. Da das Unternehmen seine KI-Systeme einsetzt, um eine personalisierte Kundenansprache zur erfolgreicheren Eintreibung von Forderungen zu ermöglichen, haben wir uns zusätzlich auf die Profilbildung einzelner Schuldner:innen und eine etwaig damit zusammenhängende verbotene automatisierte Einzelentscheidung72 über die Einleitung gerichtlicher Schritte des Unternehmens gegen die Schuldner:innen fokussiert.

In einem weiteren Fall prüften wir eine kommerzielle Fotoplattform, die nach unserer derzeitigen Kenntnis bereits ins Internet hochgeladene Fotos, die zumindest zum Teil als personenbezogen einzustufen waren, Unternehmen gegen Bezahlung auch für das Training von KI-Modellen anbot. Dieses Vorgehen war nur teilweise in der Datenschutzerklärung der Plattform abgebildet. Bei einer Immobilienvermittlungsplattform ist uns im Rahmen eines Beschwerdeverfahrens aufgefallen, dass der Betreiber die abgeschlossene und neu hinzukommende Kommunikation mit Kund:innen für das Training eines KI-Systems zur effizienteren Bearbeitung von Kundenanfragen nutzte, ohne jedoch die Kund:innen auf diese Verarbeitung hinzuweisen.

Zu einer Nachrichtenseite eines anderen Unternehmens wurde uns berichtet, dass der auf der Website eingesetzte KI-Chatbot widersprüchliche Aussagen zur Datenschutzerklärung der Website gemacht hat. So hat der Chatbot auf die Frage, welche personenbezogene Daten verarbeitet werden, ausgegeben, dass keine Daten gespeichert und verarbeitet werden, was aber im Widerspruch zur Datenschutzerklärung auf der Website stand. LLM-Chatbots können fehlerhafte oder erfundene Antworten geben, die plausibel klingen, was oft als „Halluzination“ bezeichnet wird. Der Datenschutzgrundsatz der Richtigkeit personenbezogener Daten73 und die Vorgaben zum Datenschutz durch Technikgestaltung74 gebieten es, eine Reihe von an das jeweilige KI-System angepassten Maßnahmen zur Erhöhung der Korrektheit der Antworten von KI-Chatbots zu ergreifen.75

Die Entwicklung und der Einsatz von KI-Systemen bringen häufig die Verarbeitung einer großen Menge personenbezogener Daten mit sich. Unsere ersten Prüfverfahren zeigen, dass insbesondere die Transparenz bei KI-Anwendungen vielfach noch nicht auf dem notwendigen Niveau angekommen ist. Auch wenn KI-Systeme einen schnellen Effizienzgewinn und neue Einnahmequellen für Unternehmen versprechen, ist es im Hinblick auf die damit einhergehenden datenschutzrechtlichen Risiken wichtig, die Rechtsabteilung und die betrieblichen Datenschutzbeauftragten bei deren Einführung frühestmöglich einzubeziehen. In den nächsten Jahren werden wir unseren KI-Prüffokus stetig erweitern, insbesondere im Hinblick auf die Umsetzung von Betroffenenrechten (wie z. B. Auskunfts-, Löschungs- und Widerspruchsrechte) sowie auf mit Verzerrungen einhergehende Diskriminierungen (sog. Bias). Auf nationaler sowie europäischer Ebene findet ein intensiver Austausch unter den Aufsichtsbehörden zu den datenschutzrechtlichen Fragen der Entwicklung und des Einsatzes von KI statt.76

V. Inneres und Justiz

1. Einsatz von Gesichtserkennungssystemen ohne Rechtsgrundlage

Die Konferenz der unabhängigen Datenschutzaufsichtsbehörden des Bundes und der Länder (DSK) fordert klare gesetzliche Regelungen für Gesichtserkennungssysteme.77 Den Einsatz solcher Technologien durch die Staatsanwaltschaft Berlin haben wir zur Prüfung der Rechtmäßigkeit in den Fokus genommen.

Im Frühjahr wurde uns bekannt, dass bei der Staatsanwaltschaft in verschiedenen Verfahrenskomplexen ein Gesichtserkennungssystem eingesetzt wurde. Dabei handelte es sich um ein System von fest installierten sowie mobil auf Kraftfahrzeugen betriebenen Kameras, das Bilder von Personen und Fahrzeugen erstellen und biometrisch abgleichen kann. Der Einsatz erfolgte unter Nutzung von Sach- und Personalmitteln, die in Amtshilfe zur Verfügung gestellt wurden.78 Die Staatsanwaltschaft stützt die Datenverarbeitungen auf die §§ 100h, 163f Strafprozessordnung (StPO) für die längerfristige Observation und die Aufzeichnung von Bildern auf öffentlichen Straßen und auf § 98a StPO für den Abgleich der erhobenen Daten mittels automatisierter Gesichtserkennung.

Alle drei Rechtsgrundlagen regeln jeweils nur Teilbereiche des Einsatzes von biometrischer Gesichtserkennung, aber auch gemeinsam gelesen ergibt sich daraus keine rechtliche Grundlage für den Einsatz solcher Fernidentifikationssysteme. Die Regelungen sprechen weder speziell den Einsatz solcher Systeme an, noch erfüllen sie die verfassungsrechtlichen Anforderungen für derart erhebliche Eingriffe in die informationelle Selbstbestimmung, wie sie der verfassungsrechtliche Bestimmtheitsgrundsatz erfordert.

§ 98a StPO regelt die Rasterfahndung. Diese gesetzliche Bestimmung ermöglicht den Strafverfolgungsbehörden, umfangreiche maschinelle Datenabgleiche vorzunehmen, um Personen, die bisher als Zielperson unbekannt waren, zu identifizieren. Bei dieser Methode der Überprüfung wird anders vorgegangen als bei herkömmlichen verdeckten Ermittlungstechniken: Zunächst wird ein großer Datenbestand mit Informationen zu vielen Personen, die nicht im Fokus von Verdächtigungen stehen, anhand spezifischer Kriterien analysiert. Das Ziel dieser Maßnahme ist es, diesen Personenkreis durch eine fortschreitende Selektion anhand von auf die Täterin oder den Täter vermutlich zutreffenden Prüfungsmerkmalen schrittweise zu verkleinern. Auf diese Weise sollen unverdächtige Personen ausgeschlossen oder weitere ermittlungsrelevante Merkmale ausgemacht werden.

Die biometrische Fernidentifizierung ist hingegen eine Technologie, die es – in aller Regel verdeckt – ermöglichen soll, Personen, die sich im öffentlichen Raum aufhalten, in Echtzeit aus der Ferne zu identifizieren, indem biometrische Merkmale wie Gesichtszüge gleichzeitig oder zeitnah mit Personenbildern aus Datenbanken abgeglichen werden. Die Zielpersonen sind in diesem Fall bekannt; die Datenerhebung erfolgt aber als laufende Aufnahme aus dem letztlich „dynamischen“ Datenbestand des öffentlichen Raums, aus dem vollkommen unvorhersehbar in Art und Umfang eine Vielzahl von biometrischen Informationen, Verhaltens- und Standortdaten erfasst wird. Nur mittels einer weiteren technischen Anwendung können dann die Lichtbilder und Videos in einer Form zusammengeführt und analysiert werden, die einen Abgleich ermöglicht. Diese technische Verarbeitung ist Voraussetzung, um erhobene Bilder aus dem öffentlichen Straßenland zu verwenden, da sich diese Daten in Format und Struktur von den Abgleichsobjekten unterscheiden. Auch dieser Verarbeitungsvorgang benötigt eine rechtliche Grundlage, die in § 98a StPO nicht hinreichend bestimmt ist.

Zwar erlaubt § 100h StPO unter bestimmten Voraussetzungen auch heimliche Überwachungsmaßnahmen mit technischen Mitteln, die hier vorgesehene Art der Verarbeitung von biometrischen Daten geht aber über den erlaubten Anwendungsbereich hinaus. Auch § 163f StPO, der die längerfristige Observation erlaubt, kann nicht als Rechtsgrundlage dienen. Biometrische Daten sind aufgrund ihrer einzigartigen Natur zudem besonders schützenswert und ihre Verarbeitung erfordert daher strengere Auflagen als andere Arten personenbezogener Daten.79 Eine ausreichende Rechtsgrundlage müsste den Einsatz dieser Systeme spezifisch erlauben und genauer umschreiben.

Das Bundesverfassungsgericht (BVerfG) hat die verfassungsrechtlichen Anforderungen an entsprechende Vorschriften zur automatisierten Datenanalyse konkretisiert.80 § 98a StPO genügt diesen Voraussetzungen im Hinblick auf den Einsatz von Gesichtserkennungssystemen nicht. Auch ist im vorliegenden Fall fraglich, ob die Maßnahmen angesichts der Vielzahl an betroffenen unverdächtigen Personen überhaupt verhältnismäßig durchgeführt wurden. Die Staatsanwaltschaft konnte zu entsprechenden Zahlen keine belastbaren Angaben machen. Auch die erforderliche Datenschutz-Folgenabschätzung81 konnte sie nicht vorlegen.

Die von der Staatsanwaltschaft herangezogenen Rechtsgrundlagen sehen jeweils eine richterliche Anordnung der einzelnen Maßnahmen vor. Mangels Zuständigkeit für die justizielle Tätigkeit der Gerichte erfasst unsere rechtliche Würdigung nicht die richterlichen Anordnungen der Maßnahmen in der Vergangenheit.82 Wir haben allerdings die Staatsanwaltschaft gewarnt, dass weitere entsprechende Anträge in der Zukunft gegen Datenschutzrecht verstoßen würden.83

Auch die DSK hat sich mit dem Einsatz von Gesichtserkennungssystemen durch Sicherheitsbehörden befasst und in einer Entschließung84 klargestellt, dass der einschlägige Rechtsrahmen und die Freiheitsrechte der Betroffenen – also potenziell aller Menschen – nicht hinreichend beachtet werden, wenn Behörden automatisierte biometrische Gesichtserkennungssysteme im öffentlichen Raum einsetzen und sich dabei auf unspezifische strafprozessuale Normen berufen. Die bestehenden Regelungen in der StPO bieten nach Ansicht der DSK für biometrische Gesichtserkennung im öffentlichen Raum keine Grundlage.

Der Einsatz von Gesichtserkennungssystemen durch Strafverfolgungsbehörden greift intensiv in das Recht auf informationelle Selbstbestimmung ein. Die bestehenden Regelungen in der StPO bieten für biometrische Gesichtserkennung im öffentlichen Raum keine ausreichende Grundlage. Sie erfüllen insoweit die verfassungsrechtlichen Anforderungen nicht, da sie schon nicht bestimmt genug sind, die umfassenden Möglichkeiten biometrischer Fernidentifikation zu erfassen. Sofern nach der KI-Verordnung und dem Verfassungsrecht Regelungsspielraum für den nationalen Gesetzgeber verbleibt und er den entsprechenden Einsatz als zwingend erforderlich betrachtet, bedarf es einer tiefgehenden verfassungsrechtlichen Auseinandersetzung. Dann kann ein angemessener Ausgleich zwischen dem staatlichen Strafverfolgungsinteresse und dem Recht auf informationelle Selbstbestimmung der Menschen hergestellt werden.

2. Zu weitreichende Videoüberwachung der Polizeiwache am Kottbusser Tor

Wir haben die Videoüberwachung der Polizeiwache am Kottbusser Tor vor Ort geprüft und dabei festgestellt, dass die Datenerhebungen ohne ausreichende Rechtsgrundlage erfolgen und unverhältnismäßig in die Grundrechte von Passant:innen und Verkehrsteilnehmer:innen eingreifen. Wir haben daher eine Mangelfeststellung ausgesprochen.

Die Polizei hat seit Anfang 2023 eine neue Wache am Kottbusser Tor im Zentrum Kreuzbergs eingerichtet. Die Dienststelle befindet sich in einem Gebäuderiegel über der Adalbertstraße. Zur Sicherung der Wache werden in der Unterführung Videokameras eingesetzt, die sowohl die Fußwege als auch die Fahrbahn der Adalbertstraße erfassen. Zusätzlich wird der Eingangsbereich auf der Fußgängerterrasse videoüberwacht.